MINTernational Robotics-Workshop 2024

Auch in diesem Jahr organisierte die Constructor University in Bremen in Kooperation mit dem MIT (Massachusetts Institute of Technology) und JETBRAINS drei einwöchige Workshops in den Fachbereichen der Physik, Chemie und Robotics, dessen Inhalte von Studierenden des MIT und der Constructor University vermittelt werden. Ich selbst nahm am Robotics-Workshop teil.

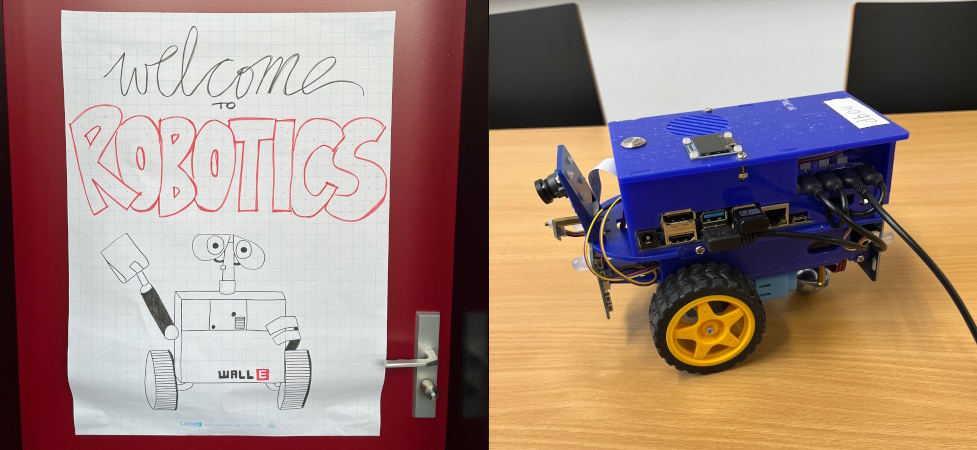

Am ersten Tag begannen wir nach einem kurzen Vorstellungsspiel und einem Plan, was uns in den nächsten Tagen erwarten würde, auch schon mit den grundlegenden Fertigkeiten in der Programmiersprache Python, die wir brauchten, um dem Roboter nachher Aufgaben geben zu können. Nach dem Mittagessen gab es schließlich eine Campustour.

Um zu verstehen, wie üblicherweise mit Robotern kommuniziert wird, übten wir am zweiten Tag, neben dem weiteren Lernen von Python, den Umgang mit dem Secure Shell Protocol (ssh), welches einem, in Bezug auf Robotics, eine sichere Fernsteuerung, Überwachung und Konfiguration von Systemen über Netzwerke ermöglicht.

Wir sollten auf unserem lokalen Computer einen ssh-key generieren, diesen dann auf einen vorher präparierten Server kopieren, sodass man beim Einloggen auf den Server kein Passwort mehr braucht, sofern man den lokalen Schlüssel hat.

Da heutzutage die meisten Roboter, wie auch unserer, auf dem Betriebssystem Linux laufen, erlernten wir im darauffolgenden Tag den Aufbau dieses Betriebssystems als auch die elementaren Befehle wie cd, ls, chmod, etc., um erfolgreich mit Linux arbeiten zu können. Zudem lernten wir an diesem Tag die elektrotechnischen Grundlagen in der Robotik kennen, wie etwa einen Operationsverstärker, der die Verarbeitung und Steuerung von elektrischen Signalen für die präzise Steuerung des Roboters ermöglicht.

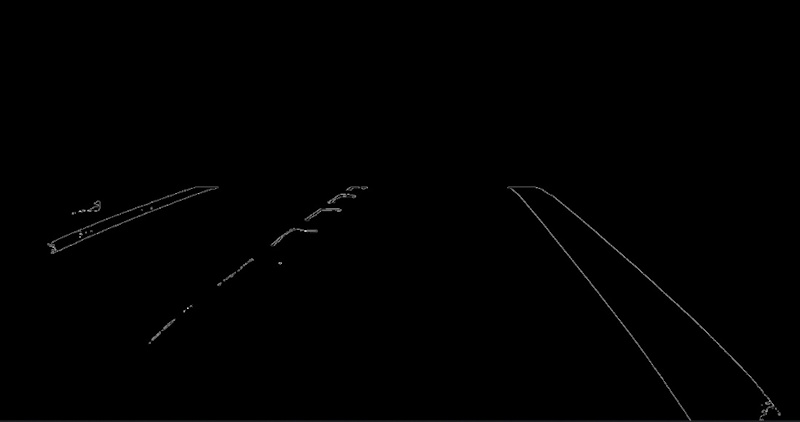

Der vierte Tag war schließlich der Projekttag, an welchem wir den Roboter die Straßenlinien einer Spielstraße erkennen lassen sollten. Dafür haben wir die OpenCV-Bibliothek in Python benutzt und uns zunächst in kleinere Teams eingeteilt. Nachdem das Video durch die Verbindung mit dem Roboter bereitgestellt wurde, wurden zunächst seine einzelnen Frames extrahiert. Dann wurde auf die einzelnen Frames ein zuvor geschriebenes Programm angewendet, dessen Logik runtergebrochen wie folgt ist:

Auf jeden einzelnen Frame wird eine schwarze Maske draufgelegt.

Weiße und gelbe Farben werden erkannt, welche daraufhin nach Schwarz-Weiß konvertiert werden und in binär dargestellt werden, d.h. Linien sind weiß (1), alles andere ist Schwarz (0).

Nachfolgend wurden die Kanten mit dem Canny-Algorithmus erkannt und die Linien mithilfe des Konzeptes der Hough-Lines gezeichnet.

Nun müssen die einzelnen Frames alle wieder in einem Video zusammengefügt werden und voila:

(Mit dem Starten des Videos gelten die Datenschutzbestimmungen von Youtube.)

Am letzten Tag haben wir anschließend eine Präsentation über das Projekt und was wir gelernt haben, gehalten.

Im Fazit kann ich sagen, dass es eine Freude war, dabei gewesen zu sein und ich mir viel Wissen aneignen konnte. Zudem fand ich den Austausch mit den Studierenden des MIT und der Constructor ebenfalls interessant. Falls du dich ebenfalls für Robotics/Informatik interessiert, kann ich es dir auf jeden Fall fürs nächste Jahr empfehlen!